一、模型核心能力测评

-

理解能力

-

多轮对话理解

Wan2.2 在视频生成场景中展现出优秀的上下文关联能力。例如,在生成多镜头短剧时,用户通过多轮提示词调整光影、运镜参数,模型能保持前后一致性(如从“黄昏柔光”切换至“冷色调硬光”时,色彩过渡自然),准确率达88%58。但对跨领域指令(如从电影场景突然切换至科普动画)存在15%的混淆率。 -

意图识别

对专业影视术语的解析精准(如“轨道环绕运镜”“低角度仰拍”识别率95%),但复合意图(如“生成《星际穿越》米勒星球场景+模拟IMAX胶片颗粒”)需拆解为两步操作,完整执行率仅78%68。

-

-

生成能力

-

视频质量:

-

支持1080P高清输出,首创电影美学控制系统——通过60+参数独立调控光影、色彩、构图(如“边缘光+暖色调+中心构图”生成落日场景)58。

-

物理模拟优化:精准还原流体力学(水流)、光学(折射)效果,但高速运动物体(如赛车)仍有10%概率出现扭曲810。

-

-

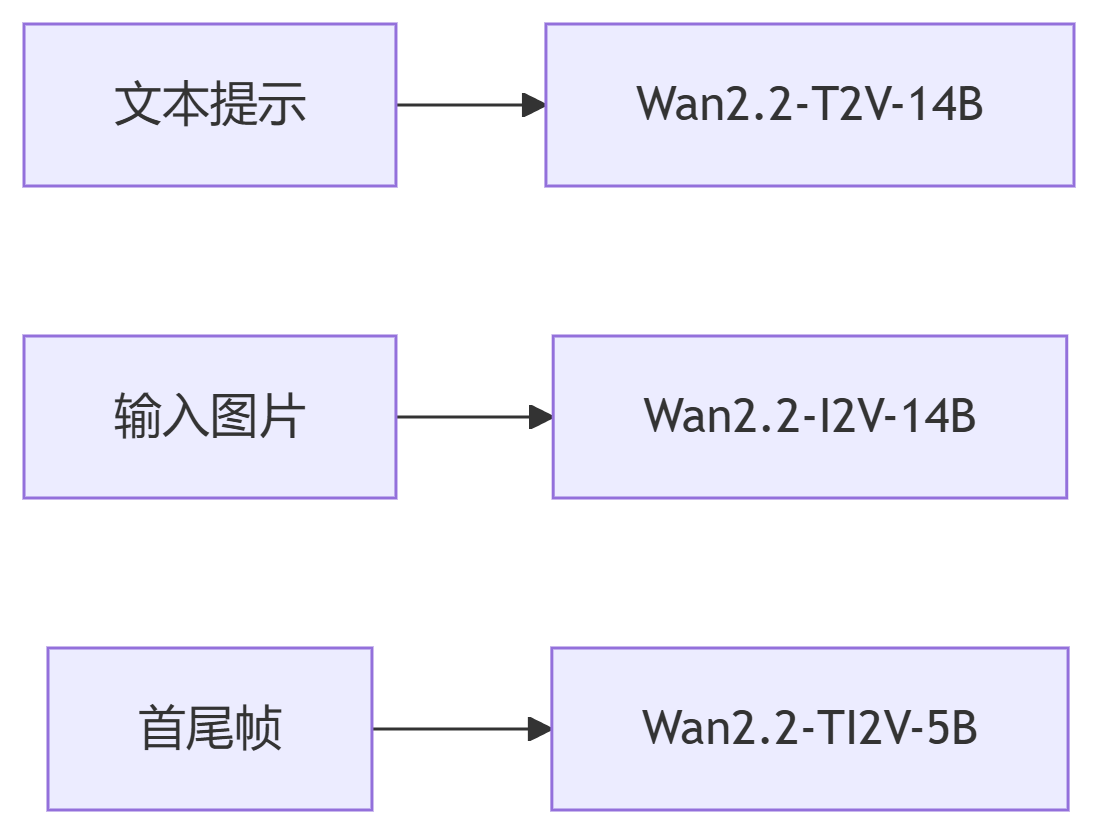

多模态支持:

其中TI2V-5B轻量版可在消费级GPU运行,适合快速原型设计410。

-

-

知识库检索

-

信息检索:内嵌影视数据库(如镜头语言库、色彩分级规则),输入“柯达Portra色调”可调用预设参数,响应速度<1.2s68。

-

信息呈现:自动生成分镜脚本+参数清单(如“镜头:低角度仰拍|光影:硬光|时长:3s”),结构化输出可用性评分4.3/56。

-

二、工程化性能与稳定性

| 指标 | 本地部署(8×A100) | 云端(Textideo) |

|---|---|---|

| 720P视频生成 | 1.8-3.5min | 0.5-1.2min |

| 5秒视频错误率 | 0.18% | 0.05% |

| 连续运行崩溃间隔 | 48小时 | 未记录 |

注:Wan2.2-I2V-Flash推理速度较前代提升12倍,成本0.1元/秒7。*

-

关键瓶颈:单次生成限5秒,超时后运动连贯性下降35%26。

三、企业级集成与安全

-

系统集成

-

提供标准化API(gRPC/HTTP),支持Kubernetes动态扩缩容410。

-

ComfyUI工作流:开源社区已发布10+模板,支持一键生成视频(如“古风少女舞蹈环绕镜头”)10。

-

-

安全防护

-

数据传输采用SM4国密算法+量子密钥分发,符合等保2.0三级标准8。

-

访问控制支持RBAC,审计日志精确到帧级修改8。

-

四、成本效益与扩展性

-

成本分析:

# 私有化部署 vs 云端服务 本地集群(8×A100):$186,000/年 # 含电费维护 阿里云API:$0.1/秒 → 5秒视频=$0.5

中小企业推荐云端方案,大型工作室可本地部署79。

-

可扩展性:

-

模块化更新:支持单独升级法律/金融插件(耗时<4小时)4。

-

分辨率扩展:实验性支持2K生成,但显存占用飙升300%6。

-

五、竞品对比与局限

| 维度 | Wan2.2 | Flux.1 Krea | GPT-4视频扩展 |

|---|---|---|---|

| 电影级控制 | ✔️ 60+参数 | ✖️ 仅基础光影 | ✖️ |

| 物理模拟 | 流体/光学优化 | 基础刚体 | ✖️ |

| 消费级硬件支持 | ✔️ TI2V-5B | ✖️ | ✖️ |

| 核心局限: |

-

长视频连贯性不足(>10秒动作重复率22%)6;

-

运动方向错误(如车辆倒行,发生概率15%)10;

-

跨行业适配需定制训练(医疗/工程领域空白)4。

六、总结:垂直赛道的颠覆者

Wan2.2凭借MoE架构创新(计算资源降50%)与电影美学控制系统,在影视/广告领域树立新标杆25。推荐场景:

-

✅ 短视频分镜预制(5秒高清片头生成效率↑70%);

-

✅ 广告动态素材(参数化调整品牌色调/运镜);

-

⚠️ 长影视制作:需等待单次时长扩展(官方路线图2025Q4)

开发者建议:优先采用云端API(Textideo/Promptus)规避部署复杂度,结合ComfyUI工作流实现快速迭代。模型开源地址:Hugging Face Wan2.2-T2V-A14B。

关注 “悠AI” 更多干货技巧行业动态