一支开源社区团队用4天时间和1.6万美元,训练出了超越Qwen2.5-VL的多模态模型,打破了高性能AI必须依赖闭源模型的神话。

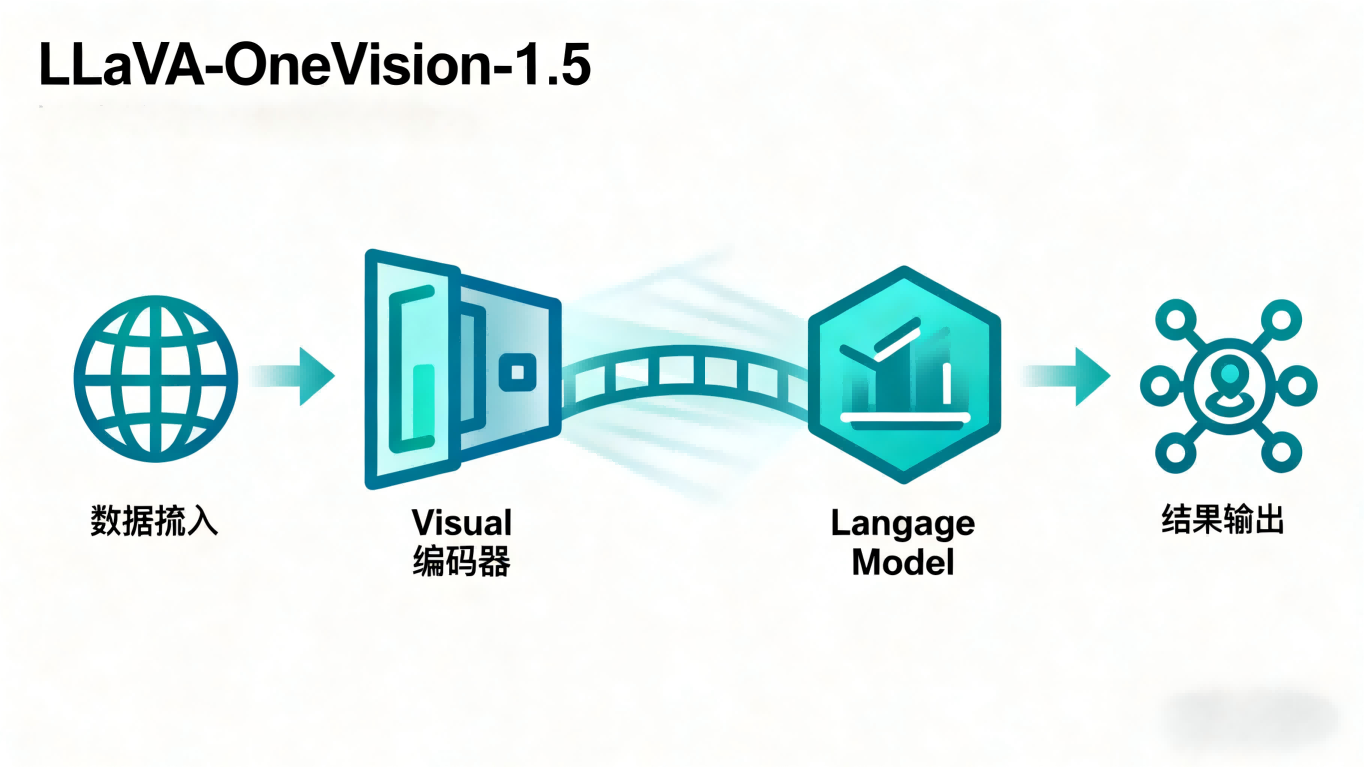

近日,开源社区迎来一项重要技术突破——LLaVA-OneVision-1.5多模态模型全面发布。这款模型在多项基准测试中表现卓越,甚至超越了先前广受好评的Qwen2.5-VL,为开源人工智能发展树立了新的里程碑。

更令人惊叹的是,如此高性能模型的预训练过程仅需4天即可完成,成本控制在约1.6万美元,展现出极高的效率与性价比。

01 破解复现难题,开源多模态的完整解决方案

LLaVA-OneVision-1.5的诞生,标志着开源多模态模型从此有了可完整复现的路径。

长期以来,开源社区存在一个尴尬现象:许多团队虽然公开模型权重,却隐藏了完整的数据清单、清洗方法和训练日程,导致后来者难以真正复现和优化。

Qwen2.5-VL、InternVL3.5等优秀模型在OCR、文档理解方面树立了高基线,但其完整配方多为部分披露,阻碍了社区的全盘复现。

LLaVA-OneVision-1.5团队决心打破这一桎梏,将“高性能—低成本—强复现”作为核心目标,提供了包括数据、工具链、配置脚本和评测命令在内的全链条资源。

这意味着研究者不再需要盲目摸索,开发者可以直接在透明基础上进行二次开发,大大降低了多模态AI的研究与应用门槛。

02 三大技术突破,铸就卓越性能

LLaVA-OneVision-1.5的成功并非偶然,它建立在三项关键技术突破之上。

视觉编码器革新是模型的第一大亮点。团队采用了自研的RICE-ViT作为视觉主干,引入区域聚类判别与区域感知注意力机制,显著提升了对图像中局部实体和文本块的建模能力。

与仅依赖单一全局向量的传统CLIP模型不同,RICE-ViT能够捕捉更细粒度的视觉语义,在OCR和文档理解任务中表现尤为出色。

独特的三阶段训练流程是模型的第二大支柱。

第一阶段完成语言与图像的基础对齐;第二阶段在概念均衡的85M预训练数据上进行全参数训练,注入广域视觉语义与世界知识;第三阶段通过22M指令数据微调,提升任务泛化能力。

数据处理的创新是模型的第三大优势。团队采用离线并行数据打包技术,将多条短样本拼接为接近目标长度的定长序列,实现了最高约11倍的padding压缩比,极大提升了训练效率。

03 概念均衡策略,优化数据根基

数据是AI模型的基石,LLaVA-OneVision-1.5在数据构建上展现了独特的智慧。

团队融合了COYO-700M、Obelics、DataComp-1B等八大异构来源,构建了包含8500万样本的预训练数据集与2200万指令数据。

面对长尾概念稀疏与原始标注噪声问题,团队没有依赖传统词频统计,而是创新性地采用了 “概念均衡”策略。

该方法利用MetaCLIP编码器将全部图像与50万规模概念词嵌入共享向量空间,对每张图像检索最相似概念,然后按逆频加权重采样。

这种方法有效抑制了高频背景类,同时提升了罕见细粒度实体、属性与场景的占比,使模型在长尾分布数据上表现更加稳健。

04 全面性能评估,超越强劲对手

经过严谨的基准测试,LLaVA-OneVision-1.5证明了其卓越的性能。

在多项公开多模态基准上,LLaVA-OneVision-1.5较Qwen2.5-VL展现出竞争性乃至更优的性能。

具体而言,80亿参数的LLaVA-OneVision-1.5-8B在27个基准中的18个上超越了Qwen2.5-VL-7B。而更小的40亿参数版本则在全部27个基准上都超越了Qwen2.5-VL-3B。

这一成果表明,高质量数据与精心设计的训练流程,有时比单纯增加参数规模更为重要。

LLaVA-OneVision-1.5的成功,为开源社区提供了宝贵经验:通过系统化的优化,即使规模有限的模型也能发挥出强大的性能。

05 应用前景广阔,推动AI普及

LLaVA-OneVision-1.5的出现,为多模态技术在各行各业的普及打开了新的可能性。

在智能客服系统中,它可以结合用户上传的截图或照片,自动识别问题并提供精准解答。

在教育领域,它能解释教材中的图表、科学图像或历史资料,帮助学生更直观地理解学习材料。

对于内容创作者,该模型可以辅助生成标题、文案、故事脚本或社交媒体内容,显著提升创作效率。

此外,在医学影像分析和自动驾驶感知等专业领域,LLaVA-OneVision-1.5也展示了潜在的应用价值。

随着技术的不断优化,我们有理由相信,多模态AI将从实验室走向更广泛的实际应用,为各行各业赋能。

LLaVA-OneVision-1.5如同一份精心编写的菜谱,提供了从数据准备到训练完成的完整指南。它证明了开源社区在追求透明、可复现的AI研究道路上能够取得非凡成就。

人工智能的未来不应被封闭在黑盒中,LLaVA-OneVision-1.5的开放理念,正是通向更包容、更透明AI世界的重要一步。

关注 “悠AI” 更多干货技巧行业动态