面对持续数周、涉及数十万行代码的重构任务,开发者的耐心和AI模型的“记忆力”同时到达极限,GPT-5.2-Codex的“上下文压缩”技术正试图破解这一困局。

OpenAI于12月19日正式推出了其迄今为止最先进的智能体编程模型GPT-5.2-Codex。这项创新基于GPT-5.2架构,专门针对智能体编码进行了深度优化,融合了GPT-5.1-Codex-Max的终端操作专长。

该模型在处理复杂的软件工程与网络安全挑战方面展现出明显优势。

01 技术突围

长程任务处理一直是AI编程助手的瓶颈。当项目需要持续数周,涉及大规模代码重构与系统迁移时,传统模型往往难以维持完整的上下文理解。

GPT-5.2-Codex通过引入原生上下文压缩技术,为这一难题提供了解决方案。

这项技术使模型能够更高效、准确地处理长期编码任务,避免了跨阶段协作中的信息丢失问题。

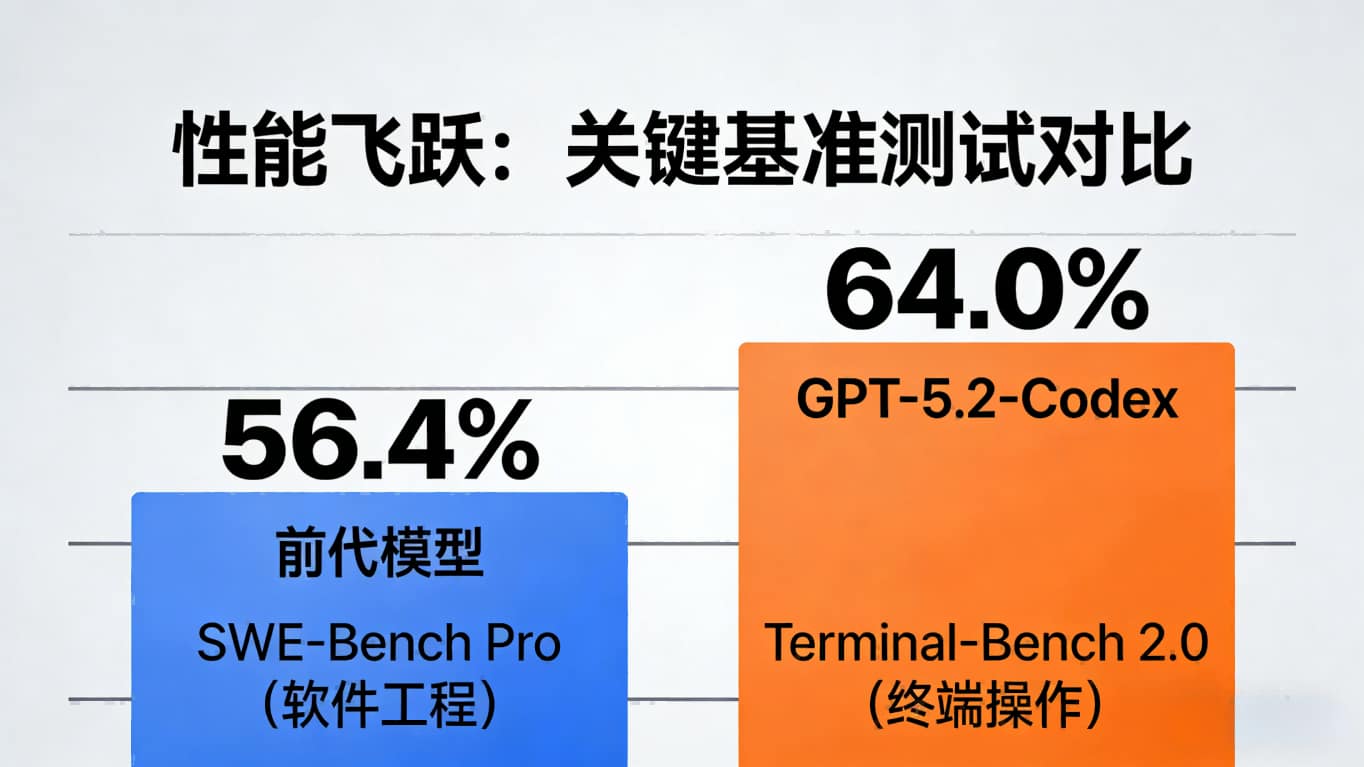

02 性能飞跃

在权威基准测试中,GPT-5.2-Codex交出了一份令人瞩目的成绩单。在评估真实软件工程任务的SWE-Bench Pro测试中,它的准确率达到了56.4%。

而在模拟真实终端环境的Terminal-Bench 2.0测试中,准确率更是高达64.0%。

与上一代模型相比,GPT-5.2-Codex在代码重构与语言迁移等场景下的执行可靠性提升了40%。平均任务耗时由前代的15分钟缩短至8分钟,错误率下降60%。

03 攻防双修

GPT-5.2-Codex在网络安全领域同样表现出色。其前代模型GPT-5.1-Codex-Max已助力安全研究员在一周内成功发现并披露了React框架中的三个重要安全漏洞。

新一代模型在此基础上进一步增强了逻辑推理与模糊测试能力。

尽管根据官方“准备框架”评估,GPT-5.2-Codex尚未达到“高”风险等级,但它已经表现出专业级的夺旗赛实战水平。

04 审慎部署

面对技术能力提升可能带来的双重用途风险,OpenAI采取了多层次部署策略。GPT-5.2-Codex目前已通过Codex CLI、IDE升级至云端环境,面向付费ChatGPT用户开放。

针对高度敏感的网络防御需求,官方同步启动了“可信访问”试点计划。这是一项仅限邀请的受控机制,旨在向通过审查的专业安全组织提供定向支持。

通过这种逐步释放能力的方式,OpenAI试图在技术普惠与风险控制之间寻找平衡点。

GPT-5.2-Codex的视觉能力也得到显著增强,现在能更精准地解读技术图表、UI截图及设计草图,快速将设计原型转化为功能性代码。

在Windows 10和Windows 11原生环境下的智能编码可靠性同样得到优化。

随着GPT-5.2-Codex逐步向更广泛的开发者社区开放,软件工程领域正迎来一个自动化程度更高、协作更智能的新阶段。从代码库导航到自动化漏洞防御,这个最前沿的智能体编码模型正在重新定义开发者的工作方式。

关注 “悠AI” 更多干货技巧行业动态

相关文章