当大多数AI图像生成工具还在依赖“猜”下一个像素时,Luma AI选择了一条更难的路:让模型先学会“思考”。

3月23日,Luma AI正式发布Uni-1图像生成模型,并同步开放了免费试用通道与API定价。这不仅是该公司首款基于“统一智能”(Unified Intelligence)架构的公开模型,更标志着图像生成领域从“概率预测”向“逻辑推理”的关键转折。

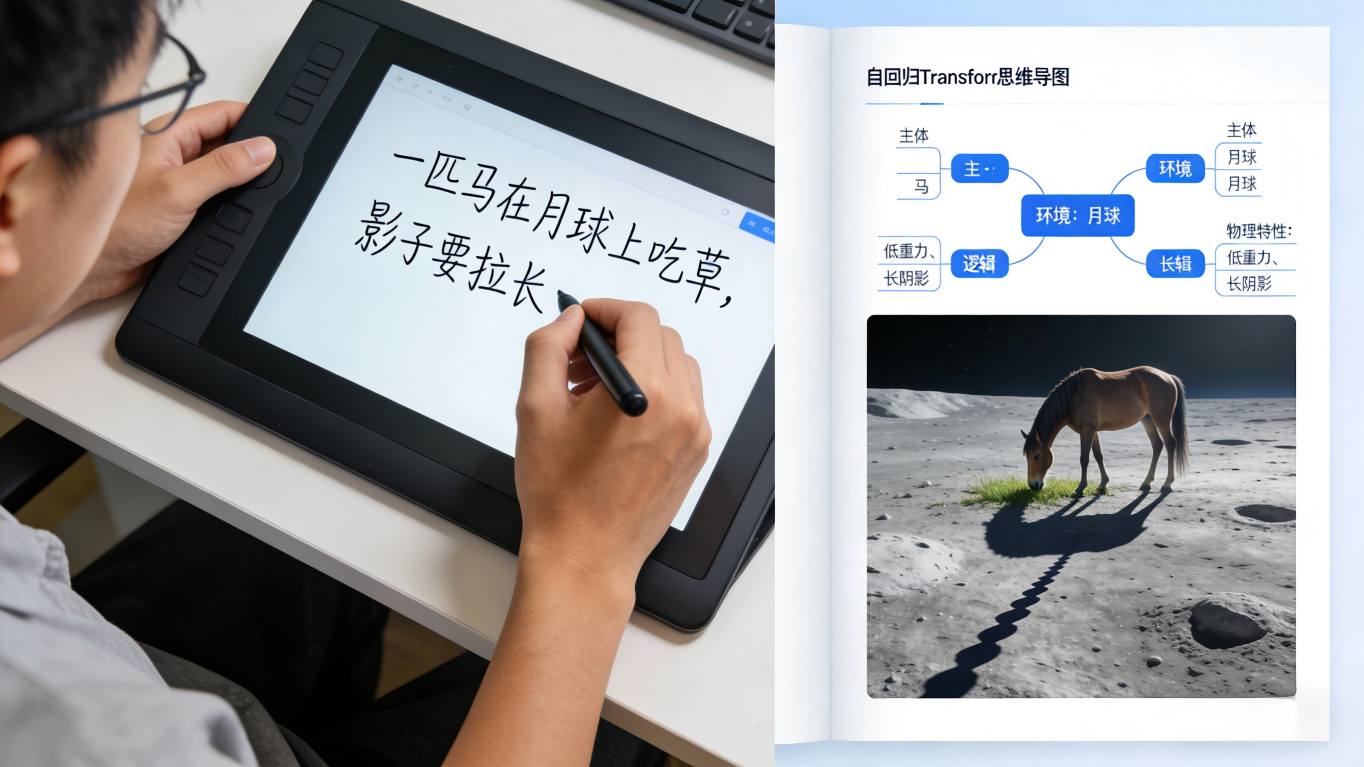

Uni-1最根本的变革在于其架构设计。它摒弃了当前主流的扩散模型路线,采用了解码器-only的自回归Transformer架构,将文本与图像视为交错排列的单一序列。这意味着Uni-1不再依赖独立的语言模型规划后再交由扩散模型渲染,而是在同一个“思维链条”中完成指令分解、空间布局规划与像素生成。

正是这种“先想后画”的能力,让Uni-1在处理复杂逻辑任务时显得游刃有余。在官方展示中,面对“生成一张包含‘新春快乐’、‘马年大吉’等多行中文的马年贺卡”这一行业公认的高难度任务,Uni-1不仅准确渲染了所有文字,还保持了剪纸风格的高度统一,而市面上的竞品则普遍出现了文字混乱或缺失。更令人惊叹的是其6帧故事板生成能力:它能在保持角色面部特征、钢琴透视和绘画风格完全一致的前提下,演绎出同一个人从童年到老年的完整一生,这种跨帧的角色一致性几乎是当前图像模型的天花板。

数据同样证明了这种优势。在评估模型逻辑推理能力的RISEBench基准测试中,Uni-1拿下了0.51的综合评分,在空间推理和逻辑推理维度上甚至达到GPT Image 1.5的两倍。而在开放词汇检测(ODinW-13)这一传统由纯理解模型主导的领域,Uni-1也达到了46.2 mAP,紧追顶尖视觉模型。Luma AI发现,当模型学会“画画”后,其“看图”的能力也同步增强——这种理解与生成的相互促进,首次在统一架构中得到了验证。

Uni-1的诞生,也是一支华人团队的胜利。这支不到15人的研究小队,由“DDIM之父”宋佳铭和CVPR最佳论文得主沈博魁领衔,在一个被谷歌和OpenAI主导的赛道上杀出了重围。目前,Uni-1已开放Web端试用,API定价约为每张图0.09美元起,在企业级2K分辨率场景下,成本比谷歌Nano Banana 2低10%至30%。

从视频模型Ray3.14到如今的Uni-1,再到基于该架构发布的Luma Agents,Luma AI正试图将AI从“离散的工具”进化为能够“看、说、推理、想象”的统一协作系统。当AI终于有了“心眼合一”的能力,创意工作的边界或许将被重新定义。

关注 “悠AI” 更多干货技巧行业动态

相关文章