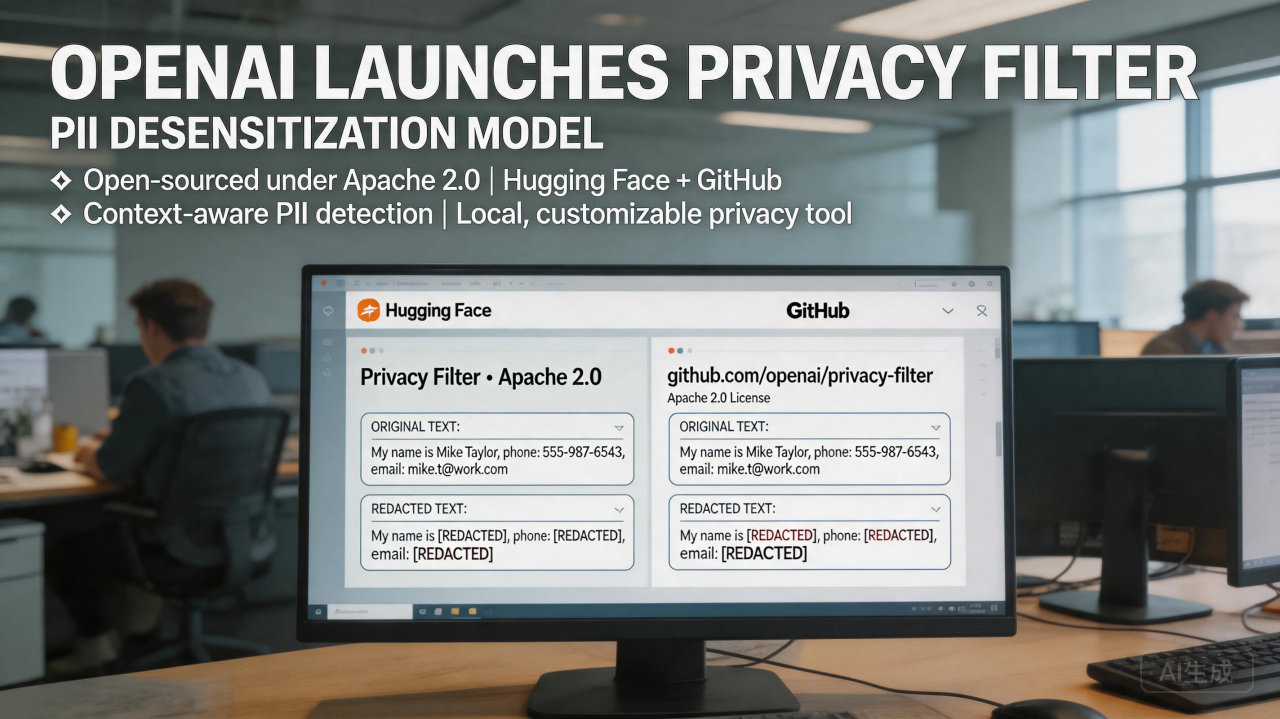

OpenAI 近日宣布推出一款前沿的个人身份信息(PII)脱敏模型——Privacy Filter。该模型目前已通过 Apache2.0协议在 Hugging Face 和 GitHub 同步开源,旨在为开发者提供一个可本地运行、支持高度定制的隐私保护工具。

区别于传统的规则匹配工具,Privacy Filter 具备深层的语言理解能力。它能根据上下文语境,精准识别非结构化文本中的敏感信息。这意味着它在有效遮盖个体私密数据的同时,能够最大限度地保留文本中的公开有用信息。

在技术架构上,该模型展现了极高的灵活性与效率:

混合专家(MoE)设计: 虽然总参数规模达 15亿,但每次推理仅激活约 5000万个参数。这使得它可以在笔记本电脑甚至浏览器等资源受限的边缘设备上流畅运行。

超长上下文支持: 具备 12.8万 Token 的上下文窗口,利用双向 Token 分类架构和受限维特比算法,确保了长文本处理的连贯性与准确性。

高精度识别: 在 PII-Masking-300k 基准测试修正版中,该模型取得了 97.43% 的 F1分数,其中召回率高达98.08%。

Privacy Filter 能够精准识别并标注八类核心敏感信息:

基础身份: 姓名、地址、电子邮箱、电话号码。

金融安全: 账号信息(含银行卡、信用卡等)。

OpenAI 将其定位为预过滤层。用户在将文本发送至云端大模型前,数据可先在本地完成 PII 检测与脱敏。这种“数据不离设备”的处理方式,有效解决了用户误将隐私信息粘贴至 AI 工具的风险。

虽然该工具功能强大且支持微调,但 OpenAI 同时也提醒,在医疗、法律、金融等高敏感领域,人工审核与领域特定的微调依然不可或缺。

OpenAI宣布终止独立编程模型Codex,将其核心能力整合进GPT-5.5主模型。这意味着GPT-5.3成为独立Codex的绝唱,标志着研发思路从“专用插件式”转向“内生全能式”,开发者将不再依赖专门编程分支。

网易有道云笔记推出“LLM Wiki”技能套件,推动个人知识库管理进入AI时代新阶段。该套件核心理念是将知识库从传统搜索引擎转变为“知识增量编译器”,实现从“被动检索”到“主动编译”的质变,以应对大模型普及下的生产力重构需求。

Anthropic 通过“Project Deal”实验,让AI模型Claude在封闭市场中自主完成买卖和价格谈判,涉及真实资金交易。实验基于Slack搭建内部市场,Claude先访谈69名员工收集意向,随后独立履行谈判职责,展示了AI在电商领域的应用潜力。

美团宣布旗下AI助手“小团”完成重大升级,入口迁移至App首页核心位置,实现全量上线。用户无需层层点击,即可一键开启智能管家服务,精准应对五一长假期间本地生活与跨城出游需求的爆发式增长,提升消费体验。

谷歌计划向AI初创公司Anthropic投资100亿美元,未来可能增至400亿美元,使其估值达3500亿美元。此前Anthropic在2月刚完成300亿美元融资,亚马逊也已投入50亿美元。

关注 “悠AI” 更多干货技巧行业动态

相关文章