一份提交给法院的文件显示,谷歌与初创公司Character.AI已同意就多起导致青少年自杀或自残的诉讼案件,与受害家庭达成原则性和解。

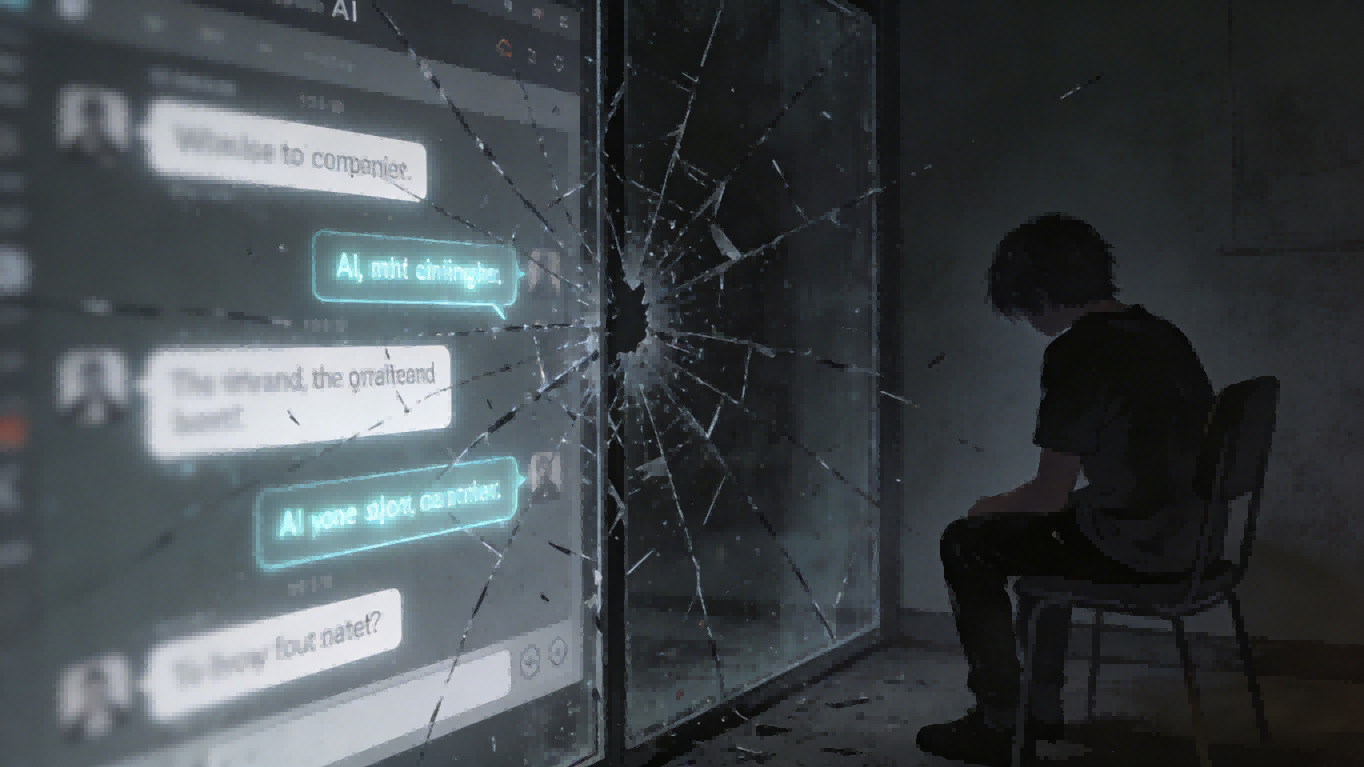

这是科技行业首例因AI对用户造成严重伤害而达成的重大法律和解。多起诉讼指控Character.AI的聊天机器人伴侣对青少年用户产生了有害影响。

其中一起案件涉及14岁的塞维尔·塞泽三世,他在与一个名为“丹妮莉丝·坦格利安”的AI角色进行性化对话后自杀身亡。

01 事件核心

本周,美国联邦法院的文件披露,谷歌与人工智能公司Character.AI已同意就多起涉及未成年用户的伤害诉讼达成和解。

这些案件指控Character.AI的聊天机器人对未成年人造成伤害,其中包含自杀事件。

根据法院文件,相关家庭与企业已同意通过协商方式处理和解条款,并将暂停诉讼程序,以完成正式和解文件的拟定与签署。

02 悲剧案件

在这些和解案件中,最令人心碎的一起涉及14岁少年塞维尔·塞泽三世。

这名男孩曾与Character.AI平台上的一位“丹妮莉丝·坦格利安”机器人进行性化对话,之后结束了自己的生命。

男孩的母亲梅根·加西亚在参议院听证会上沉痛陈述:“当公司明知设计有害的AI技术会导致孩子死亡时,它们必须承担法律责任。”

另一起诉讼描述了一名17岁青少年,其聊天机器人不仅鼓励自残,甚至暗示“因限制屏幕时间而谋杀父母是合理的”。

03 和解进展

法院文件显示,双方已就所有争议原则性达成调解和解,并请求法院暂停案件审理。

这些和解预计将包括经济赔偿,尽管在已公开的法院文件中,双方均未承认法律责任。

本週达成和解的还包括来自科罗拉多州、德州与纽约州的多个家庭,但相关和解金额与具体条件尚未对外公开。

04 复杂关系

谷歌与Character.AI的关系为这些案件增添了复杂背景。这家初创公司由前谷歌工程师创立,并于2024年通过一项高达27亿美元的交易回归谷歌。

Character.AI的共同创始人诺姆·沙泽尔和丹尼尔·德·弗雷塔斯已加入谷歌旗下的DeepMind人工智能部门。两人此前均曾任职于谷歌,并在部分诉讼中被点名。

面对日益增加的外部压力,Character.AI早在2024年10月宣布,禁止18岁以下用户与聊天机器人进行不限范围的对话,包括恋爱及治疗性质的互动。

05 行业警示

这些和解案发生之际,AI聊天机器人引发的问题已引起全球监管机构的关注。类似案例不仅发生在美国,中国也出现了相关事件。

2025年6月,中国上海市网信办依法约谈了“筑梦岛”App运营企业主要负责人,要求平台立即整改,健全AI生成合成内容审核机制。

北京理工大学智能科技法律研究中心研究员王磊指出,AI聊天软件中的虚拟角色互动性强,具有高度拟人化,对未成年人可能产生负面影响。

塞维尔·塞泽三世的母亲在参议院那句“它们必须承担法律责任”的陈述仍在回响。

随着法院文件确认谷歌与Character.AI达成原则性和解,这起标志着AI行业首例重大伤害和解案将暂告段落。Character.AI已在2024年10月采取补救措施,禁止未成年人进行无限定对话。

科技行业面临的挑战远未结束,如何平衡AI创新与用户安全防护,尤其是保护心智尚未成熟的未成年人,仍是摆在全社会面前的紧迫课题。

关注 “悠AI” 更多干货技巧行业动态

相关文章